上下文长度现在成了各模型升级的核心方向,128/256K的容量已逐渐显得不足。而作为当前公认编程能力最强的模型开发商,Anthropic今日宣布对旗下两款Claude模型进行升级,将其上下文长度提升至1M,并且保持原有价格不变。

Claude Opus 4.6与Sonnet 4.6今日已全面开放1M上下文能力,此前超过200K上下文的请求需添加beta标头,现在这一要求已取消,相关请求将由系统自动处理,开发者无需对代码进行任何修改。

不仅上下文理解能力得到显著增强,媒体处理能力也突破了原有限制,达到了之前的6倍,现在每条请求能够支持600张图片或PDF文件的处理。

而且这次是加量不加价,上下文对应一个价格,每个长度都设有完整的费率限制。

不过Claude Opus 4.6和Sonnet 4.6的整体定价目前仍是最高的,前者每百万Token的输入、输出费用分别为5美元和25美元,后者则是3美元和15美元。这样的价格让不少程序员都感到心疼,写代码时也不敢完全依赖这两个模型,得搭配其他更实惠的模型一起使用。

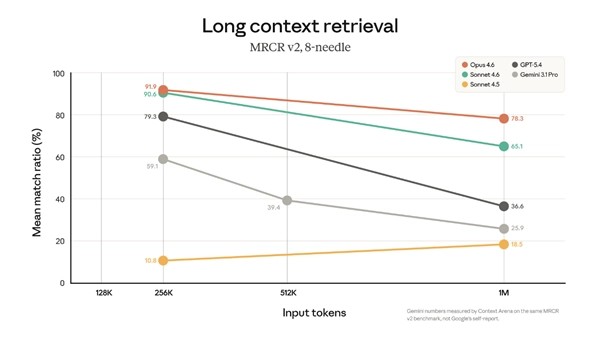

最后,即便升级到1M上下文,Claude Opus 4.6和Sonnet 4.6的能力几乎未受影响。官方测试数据表明,Opus 4.6在MRCR v2上的得分达78.3%,在相同上下文长度的前沿模型中排名第一。

最后想补充一句,DeepSeek在今年2月推出的测试模型里也实现了1M上下文的升级,尽管实际运行效果相当出色,但如今美国的闭源大模型也大多支持1M上下文了,这一点已经没什么新鲜感,外界对DeepSeek的能力期望也越来越高。

此前的传闻提到,DeepSeek V4的重要升级方向之一是编程能力的提升,还有消息称其水平能达到甚至超越Claude。不过,这个目标对于开源大模型而言或许有些过高——毕竟Claude是Anthropic投入大量资金研发的成果,加上全球众多开发者的使用,持续的数据反馈还在不断优化着Claude模型。DeepSeek要是没有全新的技术突破,恐怕很难在这一领域实现对Claude的超越。