据报道,谷歌正与Marvell Technology展开洽谈,拟联合开发一套聚焦推理任务的新型定制AI芯片。双方讨论的核心是打造专用硅芯片,以满足搜索、云服务等产品中运行AI模型的庞大且持续的需求,而非仅用于模型训练。若该合作达成,将拓展这家科技巨头现有的芯片战略,使其超越内部TPU及长期合作伙伴的范畴,同时降低对Nvidia等外部GPU供应商的依赖。

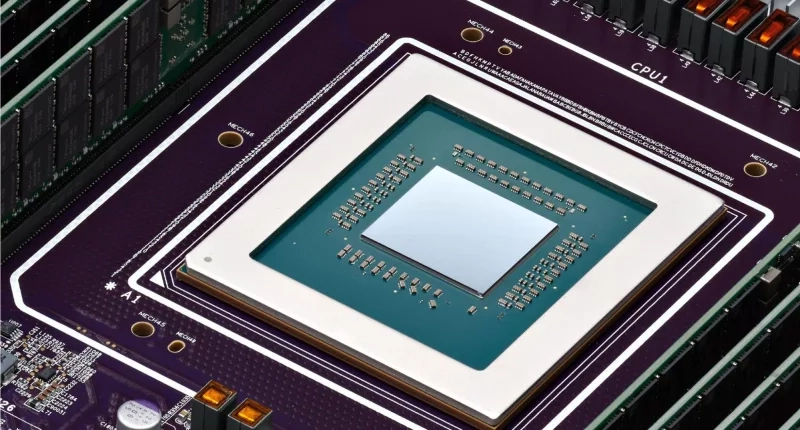

据报道,此次讨论的核心聚焦于两种不同的芯片设计方案。其中一种被定义为以内存为核心的处理器,其设计初衷是对谷歌现有的张量处理单元(TPU)形成补充,进而提升AI工作负载场景下数据移动与访问的效率。需要特别指出的是,内存带宽已成为制约现代AI系统性能的关键瓶颈,这一点在大型语言模型上表现得尤为明显——这类模型往往需要对海量存储数据进行快速访问。

与此同时,第二种设计被称作下一代推理加速器,它是定制化的TPU变体,专门优化后能以更低延迟、更少能耗为AI模型提供服务。随着AI模型不断扩展,这种专业化特性愈发关键。通用GPU尽管具备高度灵活性,却并非执行重复性推理任务的最优方案。定制ASIC可针对较窄范围的操作进行设计,从而更高效地运行,降低功耗与单次查询成本。对于谷歌这类规模的企业而言,哪怕是效率上的细微提升,也能产生可观的财务效益。

不过,这一举措并不代表会脱离现有的合作关系。谷歌多年来始终与Broadcom保持紧密合作,双方在长期协议框架下共同开发TPU,而这份协议还将延续至下一个十年。实际上,引入更多合作伙伴,似乎是谷歌为降低对单一供应商的依赖、增强供应链韧性,同时在定价与创新方面维持自身优势这一整体战略的一部分。在AI硬件需求大幅增长的当下,这种供应链多元化正越来越被视作一种战略必需。

潜在的合作意向也凸显出Marvell这类定制化硅片供应商在AI供应链中愈发重要的地位。和垂直整合的芯片厂商不同,Marvell专注于设计特定应用的集成电路,能根据大型客户的需求进行定制化开发。凭借在数据中心基础设施、高速互联技术以及定制计算解决方案领域的专业积累,它自然成为超大规模企业的理想合作伙伴——这些企业希望在不自行打造所有组件的前提下,实现硬件架构的多元化。若与Marvell的磋商能达成正式协议,开发流程可能会分阶段推进,涵盖设计定稿、原型制作与测试等环节,之后才进入全面部署阶段。

值得关注的是,这一潜在行动或许会在未来对Nvidia产生影响。目前Nvidia在AI芯片领域依旧保持领先,其GPU被广泛应用于AI模型的训练与运行,并且依托着自身强大的CUDA软件生态系统。不过,随着谷歌等企业针对推理这类特定任务开发专属芯片,它们对Nvidia硬件的依赖程度可能会慢慢降低。