今天凌晨,小米正式发布了三款大模型,分别是MiMo-V2-Pro、Omni和TTS。现阶段,这些模型已在Xiaomi miclaw、MiMo Studio、金山办公以及小米浏览器平台上线,用户可通过OpenClaw、OpenCode、KiloCode、Blackbox、Cline这些渠道接入使用,并且能享受为期一周的限时免费体验。

汇总如下:

小米面向 Agent 时代的旗舰基座模型:Xiaomi MiMo-V2-Pro

Xiaomi MiMo-V2-Pro 是为现实世界里高强度的 Agent 工作场景量身打造的。它具备超 1T 的总参数量(激活参数为 42B),运用了创新的混合注意力架构,并且支持 1M 的超长上下文长度。小米还在更广泛的 Agent 场景中不断 Scaling 算力,进一步拓展了智能的动作空间,达成了从 Coding 到 Claw 的关键泛化。在 Artificial Analysis 排行榜上,MiMo-V2-Pro 位居全球第八、国内第二。

在OpenClaw、Claude Code这类智能体框架里,MiMo-V2-Pro无需人工介入就能完成复杂工作流的编排、长程规划以及精准的工具调用,并且能持续稳定地交付最终成果。整体使用体验已经超过了Claude Sonnet 4.6,接近Opus 4.6,而该模型的API定价却只有它们的五分之一,有效降低了前沿智能技术的使用门槛。

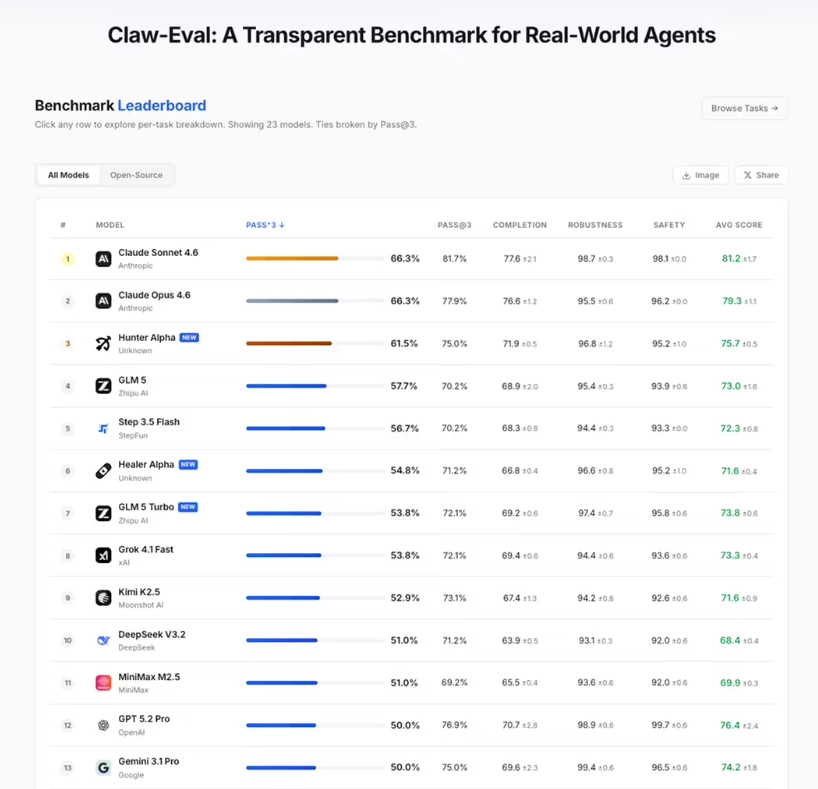

MiMo-V2-Pro 是为 Agent 场景深度优化打造的。它针对复杂多样的 Agent Scaffold 开展 SFT 与 RL 训练,拥有更出色的工具调用和多步推理能力。在 OpenClaw 标准评测体系下的 PinchBench、ClawEval 榜单中,MiMo-V2-Pro 的表现位居全球前列。此外,依托 1M 的上下文窗口,MiMo-V2-Pro 能够轻松应对高强度的真实 Claw 复杂应用流程。

MiMo-V2-Pro 可投身于更为严谨的代码工程建设工作。据内部工程师的测评结果,它的实际使用体验已趋近 Claude Opus 4.6,同时具备高阶的代码智能特性:在系统设计与任务规划方面表现更优,代码风格更为优雅,解决问题的路径也更高效直接。

MiMo-V2-Pro 模型现已正式开放 API 服务,支持 1M 上下文长度,并根据使用量分段计价:

256K 上下文以内:输入 $1 / 百万 tokens,输出 $3 / 百万 tokens

1M 上下文以内:输入 $2 / 百万 tokens,输出 $6 / 百万 tokens

访问 https://platform.xiaomimimo.com,即刻接入 API。

MiMo Claw 模块现已全面打通金山 WebOffice 生态。原生支持 Word、Excel、PPT、PDF 四大主流格式,无缝覆盖超 95% 的日常文档类型。

Xiaomi MiMo 底层推理引擎与金山办公生态实现框架级集成。WPS 灵犀现已接入 MiMo-V2-Pro 模型,向灵犀 Claw 提问或布置任务,办公更高效。

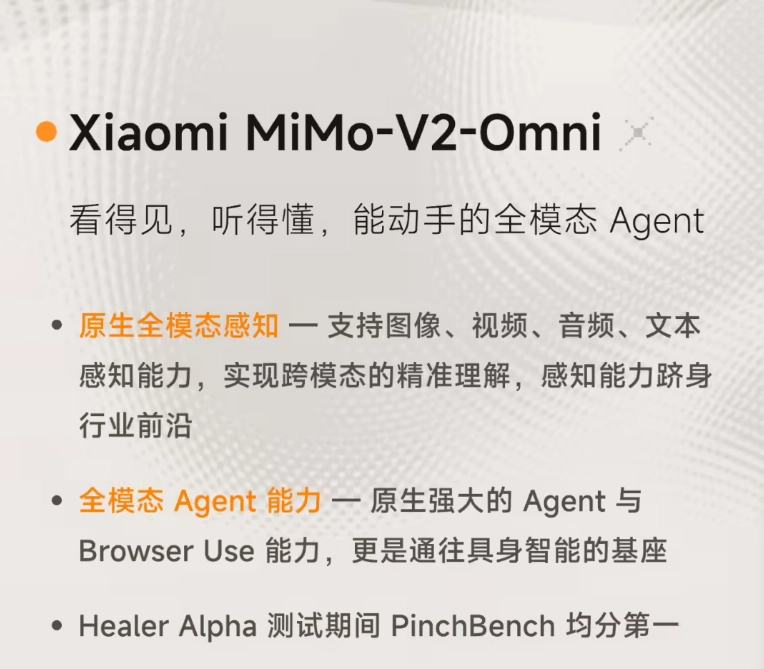

小米面向 Agent 时代的全模态基座模型:Xiaomi MiMo-V2-Omni

其专为现实世界中复杂的多模态交互与执行场景而生,可无缝接入各种 Agent 框架,实现了从理解到操控的跨越,大幅降低了全模态 Agent 的落地门槛。

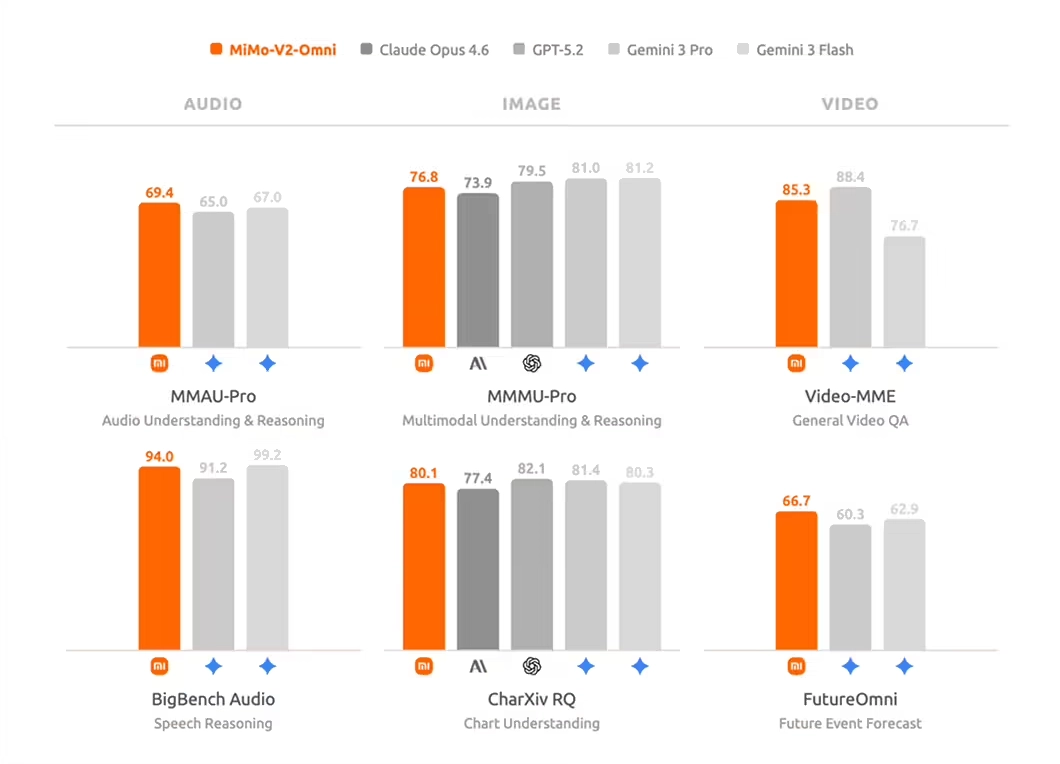

音频理解方面,支持从环境声分类、多说话人分离、音频-视觉联合推理,到超过 10 小时连续长音频的深度理解。综合表现超越 Gemini 3 Pro,是当前最强的音频理解基座模型之一。

图像理解方面,MiMo-V2-Omni 展现出强大的多学科视觉推理与复杂图表分析能力,超越 Claude Opus 4.6,逼近 Gemini 3 Pro 等顶尖闭源模型水平。

视频理解方面,支持原生音视频联合输入,实现真正的多模态视频理解。通过创新的视频预训练,模型具备强大的情境感知与未来推理能力。

MiMo-V2-Omni 能够跨模态理解复杂环境、自主制定并执行计划、在遇到异常时实时修正策略,最终端到端地交付完整结果。

MiMo-V2-Omni 模型现已正式开放 API 服务,支持 256K 上下文长度,输入 $0.4 / 百万 tokens,输出 $2 / 百万 tokens。

访问 https://platform.xiaomimimo.com,即刻接入 API。

此外,MiMo-V2-Omni 携手 OpenClaw、OpenCode、KiloCode、Blackbox 以及 Cline 这五大 Agent 开发框架团队,面向全球开发者推出为期一周的限时免费接口支持服务。

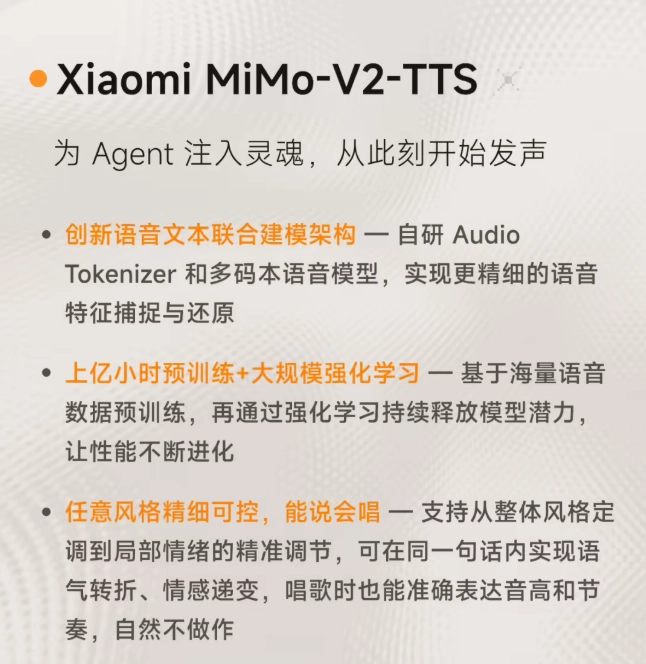

专为 Agent 时代的全模态交互而生:Xiaomi MiMo-V2-TTS 语音合成大模型

Xiaomi MiMo-V2-TTS 是小米自主研发的语音合成大模型。该模型依托自研的 Audio Tokenizer 及多码本语音-文本联合建模架构,通过上亿小时语音数据的大规模预训练与多维度强化学习,达成了高度可控的多粒度语音风格调控。MiMo-V2-TTS 可实现从整体风格定调到局部情绪表达的精准调整,能够在同一句话中完成语气的转折与情感的递变;还能真实复现人类说话的自然韵律;在唱歌场景下,也能准确传递音高与节奏,表现自然且富有感染力。

在训练阶段,MiMo-V2-TTS 先借助超大规模的语音-文本混合预训练,从海量数据里掌握了强大的跨模态对齐能力,以及理解与生成相统一的能力;在此前提下,再通过少量高质量监督数据的微调,模型便具备了可泛化的多粒度和多风格指令控制能力。

为进一步释放模型在大规模预训练中沉淀的高表现力语音生成潜能,小米采用了多维度强化学习,实现了稳定性与表现力的平衡。具体来说,MiMo-V2-TTS 在强化学习环节,针对更自然的韵律、更稳定的音质、更精准的字词传递、更优质的音色复刻以及不同场景下适配的语气和表达形式等多个维度不断迭代优化。借助多层码本建模架构,模型在高保真的离散token空间中对语音展开建模,完整留存了原始语音里的丰富信息,让强化学习阶段可以直接借助语音相关奖励信号对模型进行调校,进而使多维度奖励信号更高效地参与到生成流程中。

MiMo-V2-TTS 支持从整体到局部的多层次语音风格控制。用户可通过自然语言指令设定整体语音基调,同时对句内局部片段进行细粒度的情绪调节,实现同一语句中语气转折与情感递变的自然过渡。

该模型还具备丰富的多元表达能力:支持多种方言的自然发音,可进行角色扮演式的风格化演绎,更能实现高质量的歌声合成 —— 让同一个模型既能说、能演、也能唱,支持东北话、四川话、河南话、粤语、台湾腔等多种方言。