中国人工智能初创企业MiniMax于今日发布M2.1,该产品在应对真实世界复杂任务、支持多编程语言以及适配办公场景等方面,性能与代理能力均得到显著增强。

M2.1的核心优势体现在多编程语言编程能力的大幅强化,涵盖Rust、Java、Golang、C++、Kotlin、Objective-C、TypeScript以及JavaScript等。与此同时,它在网页、Android和iOS用户界面的美学设计感知与实现能力方面也取得了进步。

M2.1在系统性问题解决能力上有所升级,除了重视代码执行的准确性外,也更加关注带有额外或复杂指导的指令的执行情况。相关公司指出,这一升级提升了其在实际办公场景中的可用性,毕竟即便是简单的规则,也可能存在复杂的细节差异。

为实现这一目标,公司不仅强调卓越的编码能力,还提升了对话和写作技能。该模型在日常对话、技术文档和写作方面表现出色,并能够提供结构化的响应。

我们的用户已习惯依赖MiniMax提供的前沿编码辅助,所需成本仅为同类服务的一小部分。早期测试表明,M2.1在架构设计、流程编排、代码审查及部署等各个环节均表现优异。开源代理AI编码代理公司Kilo Code Inc.的联合创始人兼首席执行官Scott Breitenother如是说道。

MiniMax M2在今年十月底正式发布。据公司介绍,M2.1在多语言场景下展现出明显的性能提升,特别是在该场景中,它不仅超越了Anthropic PBC的Claude Sonnet 4.5,还与更大型、更复杂的Claude Opus 4.5十分接近。

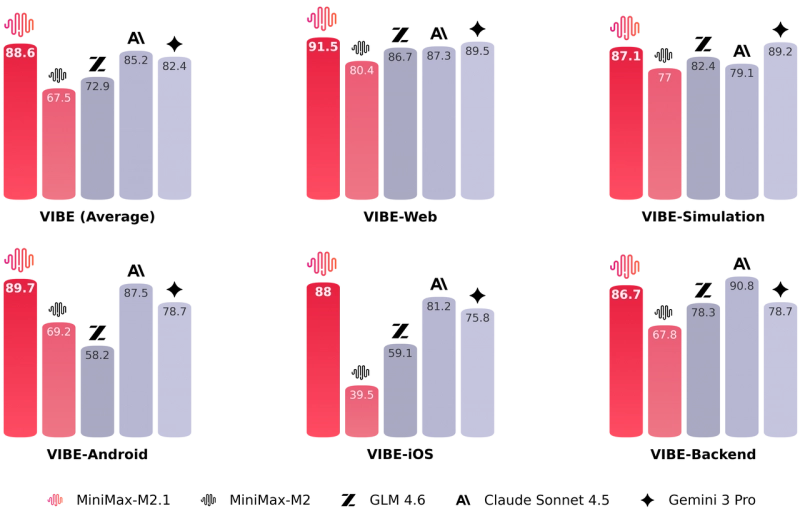

作为评估工作的一环,MiniMax构建了一个全新的基准——VIBE,也就是执行层面的视觉与交互基准。这个套件包含网页、模拟、Android、iOS以及后端开发这五大核心能力模块。和其他基准有所区别的是,VIBE采用以代理充当验证者的语言配置方式,这一特点让它能够对生成应用的交互逻辑与视觉美学进行评估。

M2.1在VIBE基准测试中表现出公司所称的“出色表现”,平均得分为88.6。它在VIBE-Web和VIBE-Android子集中特别出色,得分分别为91.5和89.7。

公司还在涵盖编码和知识领域的全面行业基准测试中,将新模型与Anthropic、Google LLC、OpenAI Group PBC及DeepSeek等大型供应商的模型进行了对比测试,这些基准包括MMLU-Pro、人类最后的考试以及针对AI代理的Toolathon。

该模型在代理工具运用、真实世界知识储备以及复杂问题解决能力上展现出稳定的卓越性能。在HLE无工具测试中,它取得了22.0的分数,这一测试是极具挑战性的学术基准,涵盖了数千道跨多学科的研究生层级多模态题目。而在MMLU这一同样覆盖广泛学科知识的基准测试里,该模型获得88分,这一成绩与顶尖前沿模型不相上下或十分接近。

该模型既可以作为MiniMax的应用程序编程接口使用,也能从HuggingFace下载,且带有开放权重。不过目前相关页面还未开放。而公司的旗舰服务MiniMax Agent,正是基于全新的MiniMax-2.1打造的。