深度求索推出的功能强大的AI大模型DeepSeek,于2025年1月11日正式上线。其中DeepSeek-R1的性能可与OpenAI o1正式版对标,其手机应用曾登上美区App Store单日下载量榜首,这不仅对ChatGPT的统治地位造成了冲击,也影响了世界AI格局,让更多大众认识了DeepSeek。

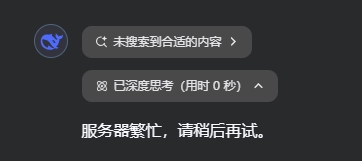

但因为DeepSeek时常遭遇网络攻击,加上访问量过大,用户和DeepSeek对话时,总是会碰到“服务器繁忙,请稍后再试”的提示,这让很多用户都觉得困扰,那有没有什么有效的办法能解决这个问题呢?

答案是有的,那就是让用户在本地部署DeepSeek大模型。不过这种方法对电脑配置要求较高,普通用户最多只能部署“残血版”的DeepSeek模型,使用体验远不如官网的“满血版”。但如果你的使用需求不高,对信息时效性也没有特别要求,那还是可以勉强用的。接下来就进入正题,给大家分享一份DeepSeek本地部署的保姆级教程。

①本地安装Ollama

这里给大家说明一下,Ollama是个开源框架,借助它你就能在本地运行大模型,其他的不用过多关注,了解这一点就足够了。

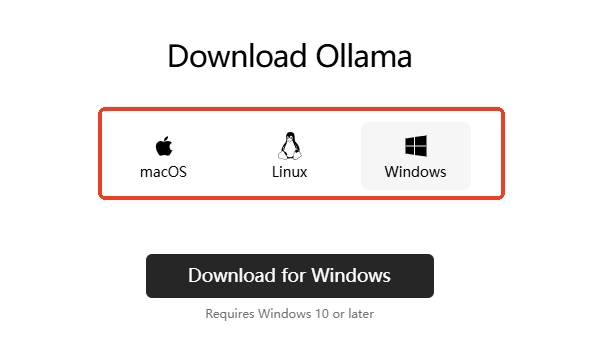

进入Ollama官网,选择合适的版本下载即可。

官网:https://ollama.com/

根据你的系统选择您需要下载的Ollama版本。

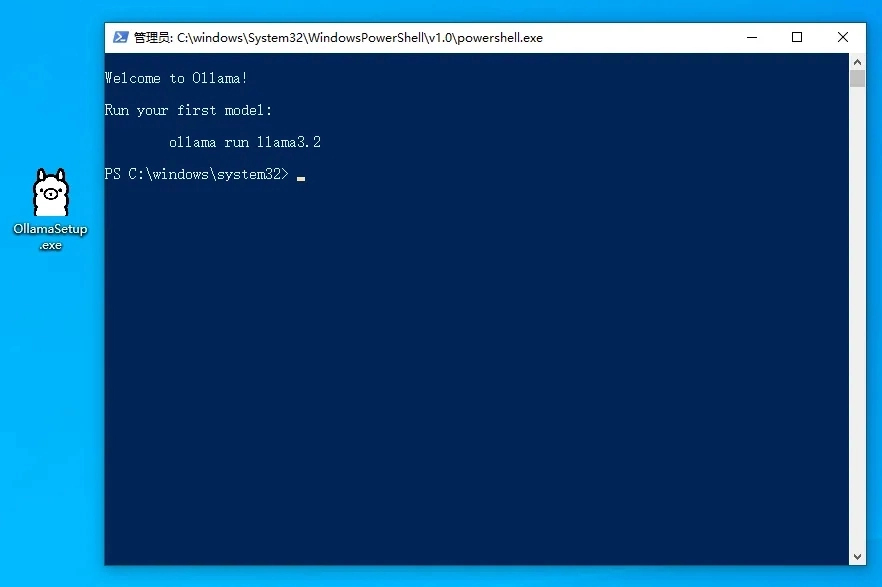

点击“安装”按钮完成下载后,安装成功会弹出命令行界面。Ollama本身没有可视化界面,但这并不影响后续使用,毕竟它只是一个框架。

完成上述步骤后,基础就打好了。

②下载DeepSeek-R1模型

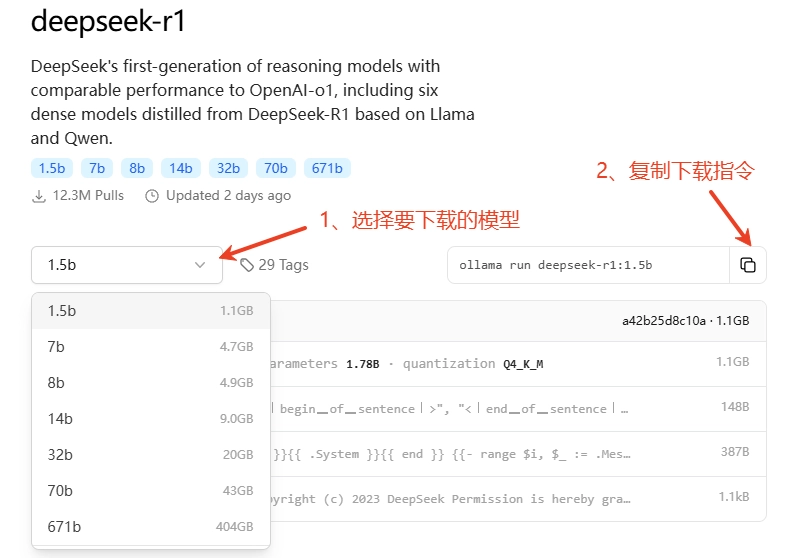

访问下方链接,选择要下载的模型,并在右侧复制对应的命令,这里以最小的1.5b版本作为演示。

https://ollama.com/library/deepseek-r1

选择好您要下载的模型,并复制下载的指令。

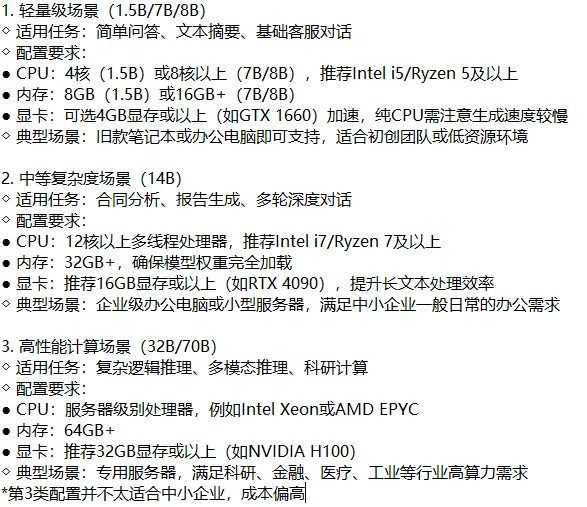

DeepSeek-R1模型相关参考标准如下:

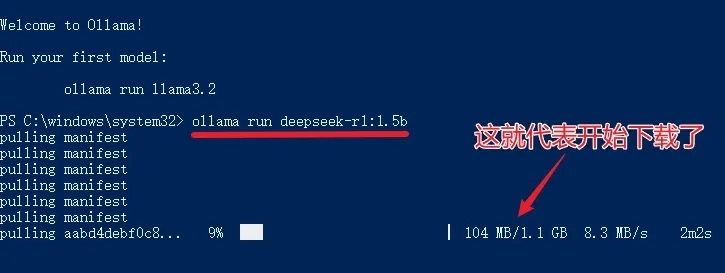

以1.5b版本为例,复制命令后粘贴到命令行中运行即可下载,速度取决于你的网速。

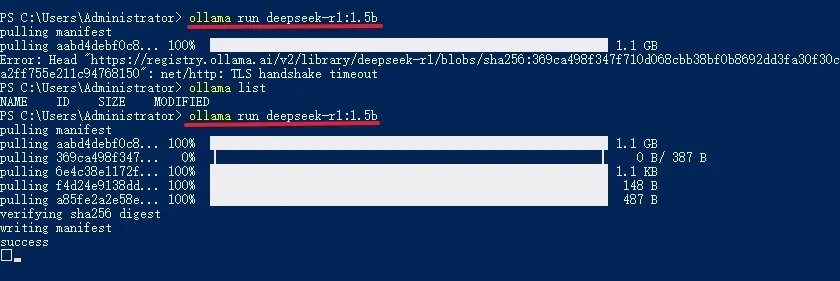

如果下载完成后报错,就再运行一遍下载命令,提示“success”就代表下载完成了。

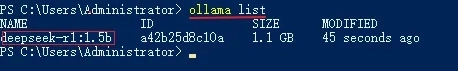

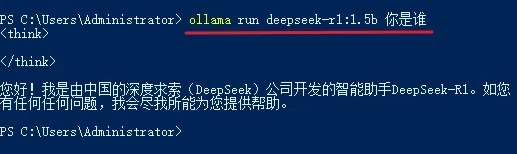

然后在命令行里输入“ollama list”来查看下载成功的模型,下图这种情况就代表一切准备就绪了。

接下来在命令行中输入「ollama run deepseek-r1:1.5b+问题」就能开启AI对话;要是你下载的是7b模型,就输入「ollama run deepseek-r1:7b+问题」,其他模型也按这个规律操作即可。

很明显,用命令行来进行交互显得有些不够高级,所以我们需要借助一款第三方AI客户端来调用本地模型,以此提升使用体验。

③通过Cherry Studio调用模型

官网(Win+Mac+Linux):

https://cherry-ai.com/

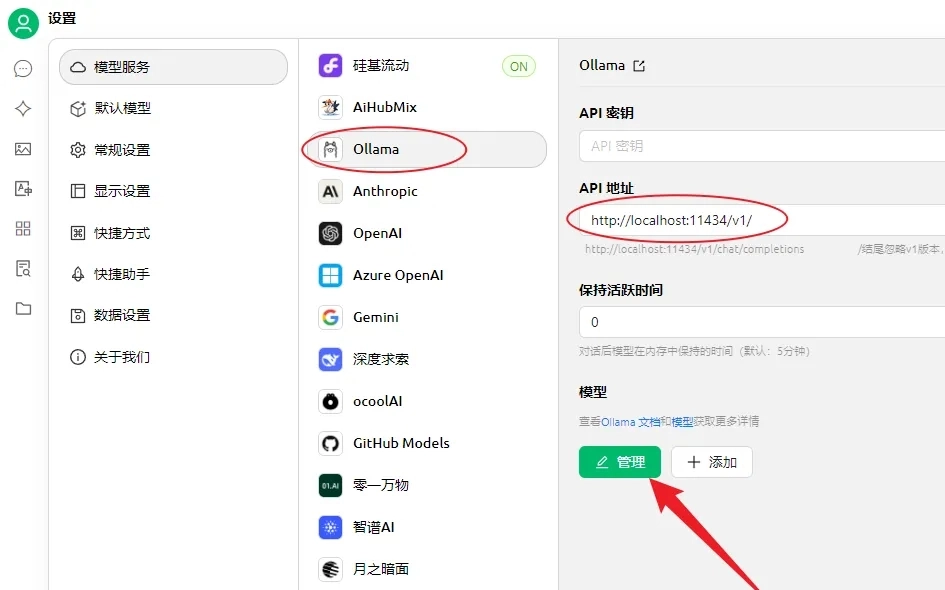

下载客户端并打开后,进入设置界面,找到「Ollama」选项并点击,此时API地址会自动填充,需确保该地址与下图所示地址完全一致,之后点击“管理”按钮即可。

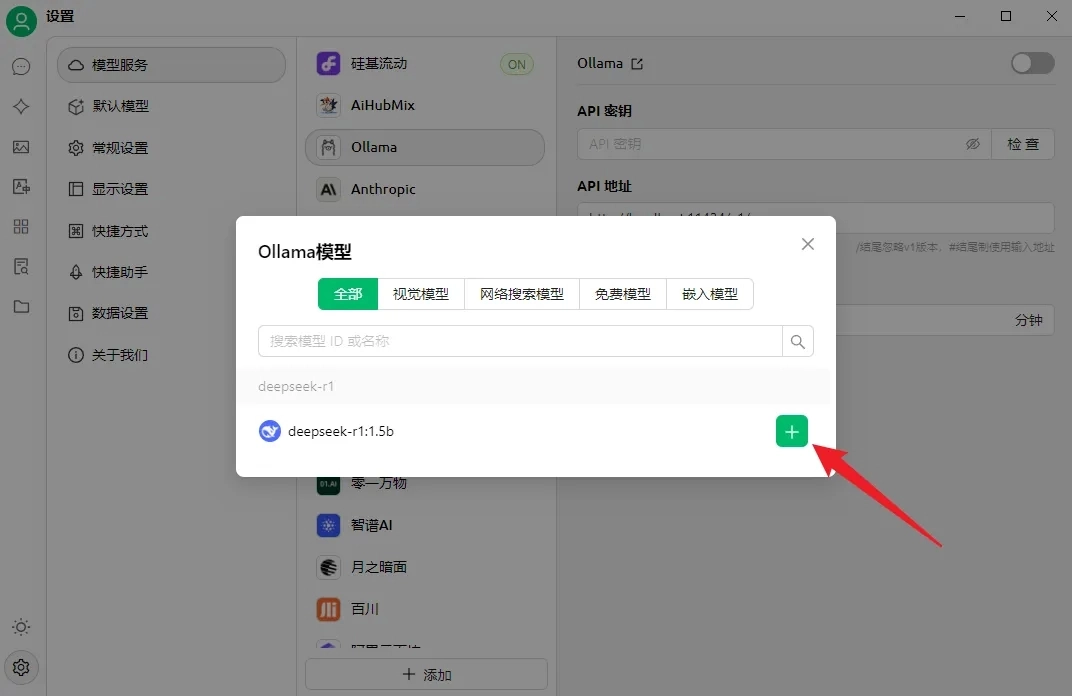

在弹出的窗口中可以看到自己本地的模型,点击右侧的按钮添加模型即可。

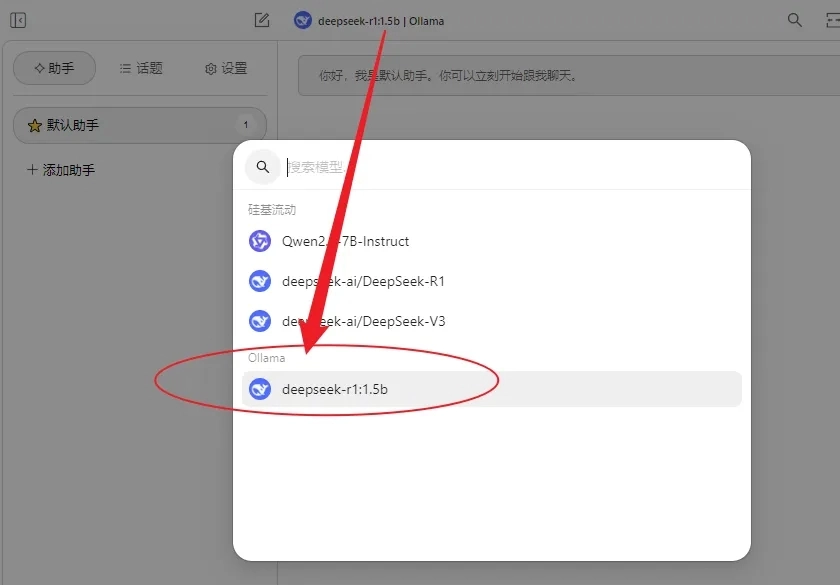

最后进入对话页面,点击顶部模型名称切换成本地部署的模型,至此大功告成。