1月27日消息,继去年年底谷歌、亚马逊相继推出自研算力芯片后,作为全球云计算“三巨头”之一的微软,终于在本周拿出了成果——此前备受关注的Maia 200芯片正式发布。

微软在公告里提到,这款以“推理”为核心设计的芯片,在多项测试里表现都超过了亚马逊的第三代Trainium以及谷歌的第七代TPU。也正因为如此,微软直接把Maia 200称作“所有超大规模云服务商里性能最顶尖的自研芯片”。

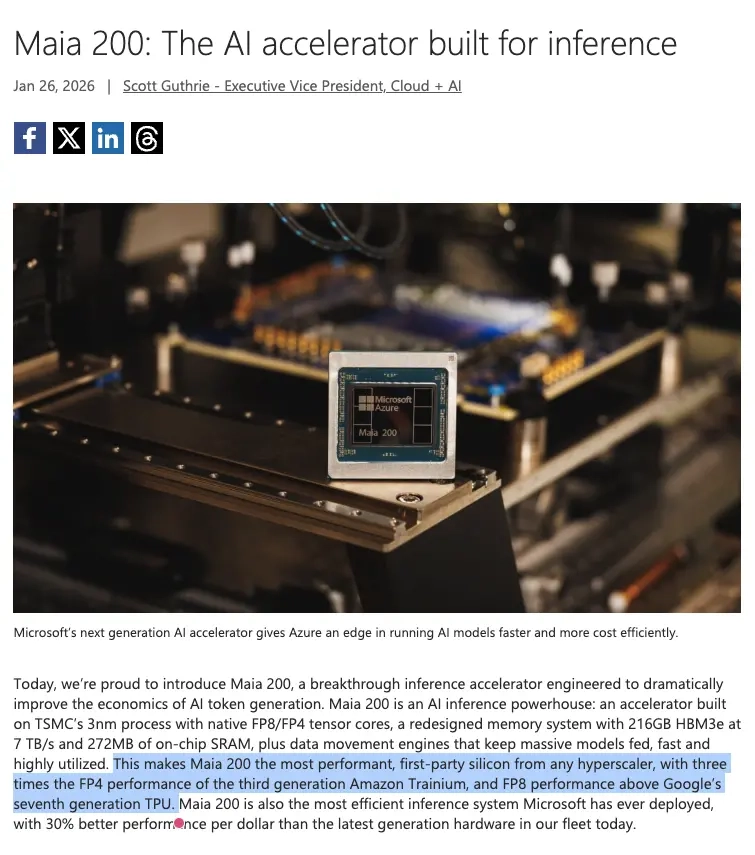

(

据公司方面介绍,Maia 200芯片采用台积电3nm工艺生产制造,芯片内部搭载了原生FP8/FP4张量核。该芯片集成了超1400亿个晶体管,是专门针对大规模AI工作负载设计的,尤其适用于采用低精度计算的新一代AI大模型。

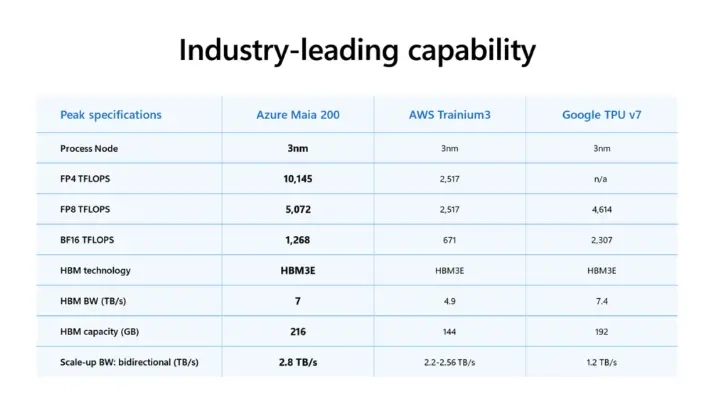

微软方面透露,单颗Maia 200芯片在4位精度(FP4)模式下可实现超10 PetaFLOPS的算力表现,8位精度(FP8)时也能达到5 PetaFLOPS以上,并且整个系统级芯片(SoC)的热设计功耗可控制在750W以内。这家科技巨头还特别指出,在实际应用场景中,单块Maia 200芯片就能顺畅运行当前规模最大的AI模型,同时也为未来更复杂的大型模型预留了性能空间。

除了芯片自身的算力表现,微软在存储参数方面也下足了功夫。据公司透露,Maia 200搭载了216GB、带宽高达7TB/s的HBM3e,同时配备272MB的片上SRAM。在扩展能力上,每块芯片可提供2.8TB/s的双向专用扩展带宽,能够支持在由6144个加速器组成的集群中实现可预测的高性能集合操作。

因此,微软芯片在“跑分”方面胜过另外两家竞争对手也在预料之中。微软在公告里提到,Maia 200的FP4性能是亚马逊第三代Trainium的三倍多,并且在FP8性能上超过了谷歌第七代TPU。

除了性能表现之外,作为云服务提供商自主研发的芯片,成本控制同样是重要考量因素。微软方面表示,Maia 200是该公司目前投入使用的效率最优的推理系统,它的“单位美元性能”较现有集群里的最新一代硬件提高了30%。

在云服务商纷纷布局自研芯片的大背景下,AI服务的逐步成熟使得推理成本在整体运营中的重要性与日俱增,这推动云服务供应商开始思考如何针对这一特定需求打造更具性价比的解决方案,尤其是要在性价比上超越英伟达GPU。其实,微软、谷歌和亚马逊推出的自研芯片,核心都是为了承接原本由英伟达GPU负责的计算任务,进而实现整体成本的降低。

值得注意的是,微软对芯片的“优化”似乎并不局限于英伟达。据该公司透露,每台Maia 200服务器配备4块芯片,采用以太网进行连接,而非InfiniBand标准。要知道,InfiniBand交换机正是英伟达在2020年收购Mellanox之后推出的产品。

微软透露,目前正在为美国中部地区的数据中心配备最新款芯片,之后会在更多地点部署。目前尚不清楚Azure云服务的用户何时能使用搭载该芯片的服务器。

微软此前也表示,已经在设计该芯片的后续产品Maia 300。科技巨头也与OpenAI达成协议,可以使用初创公司的芯片设计。

【