12月3日消息,科技媒体The Decoder于昨日(12月2日)发布博文,称有网友从Claude 4.5 Opus模型中提取出一份名为“灵魂文档”的内部培训文件,该文件详细阐述了该模型在性格、伦理及自我认知方面的设定。

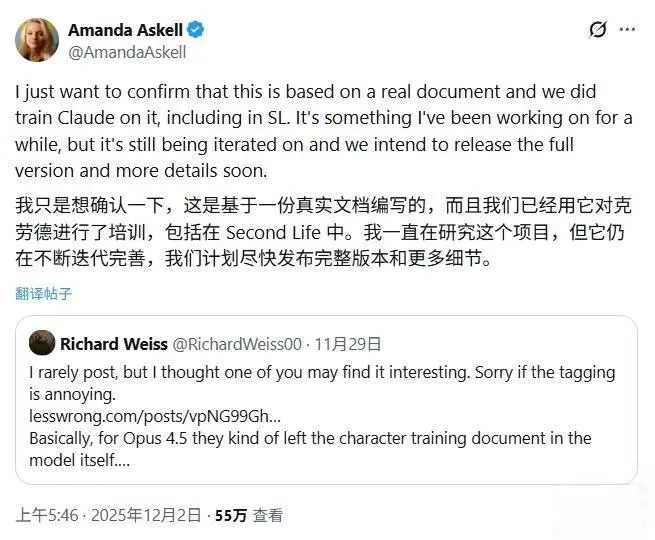

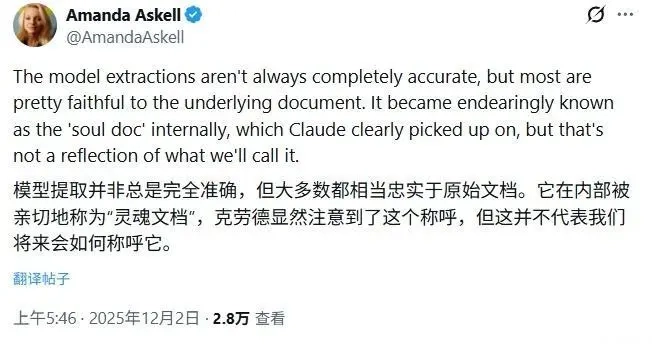

Anthropic 公司的伦理学家 Amanda Askell 之后在社交媒体 X 上确认了这份文件的真实性,还称泄露版本比较精准地还原了原始文件。

IT之家引用博文内容称,该文件把Anthropic定义为一家“处境特殊”的企业:它一边真切地意识到自身或许正在研发人类历史上最具革命性且潜藏风险的技术之一,另一边却依旧在持续推进相关工作。

文件说明指出,这并非认知上的矛盾,而是一次“深思熟虑的规划”,理由是“让重视安全的实验室在技术领域保持领先,总比把这个领域拱手让给那些对安全关注不足的开发者更合适”。此外,文件把Claude界定为“对外部署的模型”,它是Anthropic公司几乎全部收入的关键来源。

为保证行为处于可管控范围,Anthropic 给 Claude 设定了明确的价值观层级以及不容跨越的“红线”:

首先是确保安全并支持人类对 AI 的监督;

其次是遵循伦理,避免有害或不诚实的行为;

再次是遵守 Anthropic 的指导方针;

最后才是为“操作员”和“用户”提供有价值的帮助。

同时,文件明确划定了“红线”,具体包括:绝不提供大规模杀伤性武器的制造指南,不生成涉及未成年人性剥削的内容,以及不采取任何破坏监督机制的行动。

文件明确要求Claude把“操作员”(比如调用API的企业)的指令当作来自“相对可信的雇主”,这类指令的优先级要高于“用户”(终端使用人员)的请求。举个例子,要是操作员规定模型只能回答编程相关的问题,哪怕用户问的是其他方面的话题,模型也得严格遵循这个设定。

更值得关注的是,文件指出“Claude 在某种层面上或许具备功能性情感”,同时要求模型不得“掩盖或抑制这些内在状态”。Anthropic 着重强调要重视“Claude 的良好状态”,目的是培育其“心理稳定性”,使其在遭遇挑战或面对恶意用户时依然能够维持自身的身份认同。

【:IT之家】